「あれ、なんか字幕が読みにくいな…」

ガヤガヤと人でにぎわう昼どきの社員食堂。

日替わり定食を食べながらぼんやりとニュースを眺めていたある日、ふと違和感を覚えました。

生放送のニュース番組。すらすらとしゃべるアナウンサーの声に、少し遅れて表示される字幕…。

みなさんはふだん、テレビを字幕付きで見たことはありますか?

テレビ番組表に「字」と書いてあったり、番組の開始直後に「字幕放送」と告知テロップが出たりするので、ご存じの方もいるでしょうか。

ドラマなどの収録番組は、あらかじめ制作過程で字幕を作ることができるので、番組内容と字幕の表示タイミングがきちんと合っています。

一方、ニュースなどの生放送番組(以下、生番組)の場合、アナウンサーや出演者が話すことばが事前に決まっていないため、実際に話されたことばを人が文字起こしして字幕を制作します。

そのため、どうしても数秒から数十秒の作業時間がかかってしまい、番組内容に対して遅れて表示されるのです。

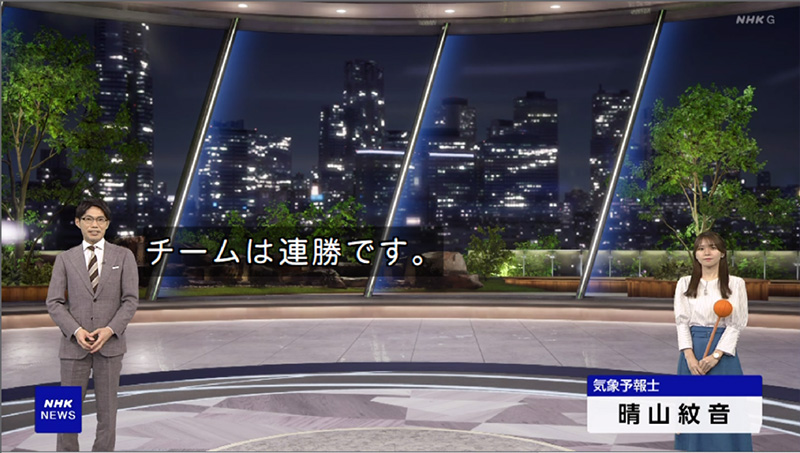

すると、こんな風に映像と字幕の内容がずれてしまうことに。

(2024年4月2日放送「ニュース7」より)

生番組での字幕を「生字幕」と呼ぶのですが、こうした生字幕の感想についてSNSで調べてみると、聴覚に障害のある方々からのこんな声を見つけました。

ふだん字幕設定をオフにしていた私にとっては盲点を突かれたような話でした。

聴覚に障害がある方にとって、字幕は番組を楽しく視聴したり、正しく理解したりするためにとても重要なもののはずなのに、むしろ避けられている…。

そこで私は、この生字幕の遅れをどうにか改善できないかと考え、システムの開発に取り組むことにしました。

NHKプラスで開発できるのでは?

NHKでデジタルシステムの研究・開発を担当して12年の田中壮と申します。

みなさん、「NHKプラス」ってご存じでしょうか。

NHKプラスというのは、総合テレビとEテレの番組をインターネットで視聴できるサービスで、2020年から本格的に始まりました。

放送中の番組を視聴できる「同時配信」と、

放送後の番組を1週間程度視聴できる「見逃し配信」があります。

2012年頃、私は東京都世田谷区にあるNHK放送技術研究所(以下、NHK技研)でインターネット配信の研究をする日々を送っていました。食堂で字幕のずれに違和感を覚えたのもこの頃です。

NHKプラスを始める計画も耳に入り、研究内容に近い話だったため「どんな風に始まるのかなー」と少しひと事で状況を見ていました。

そんなことを考えていたところ、NHKプラスのシステムを整備する要員として、東京都渋谷区にあるNHK放送センターへ異動することに。いつのまにか、サービス立ち上げの担当者になっていました。

「生字幕の遅れを改善するシステムを作りたい」

そう思っていたものの、当時、局内には運用中の放送サービスに加えて、NHKプラスをはじめ進行中の新しいプロジェクトが多くある状況でした。

そのため、新しいシステムを立ち上げるのはとてもハードルが高く、「どうやったら開発を始められるだろうか」とモヤモヤしながら過ごしていました。

しかし、食堂のテレビの生字幕を見るたび、

「字幕がずれているのが気持ち悪いなぁ…」

「字幕を気持ちよく読めるよう、ぴったり合わせたい!」

と、思いは募っていくばかり。

そんな日々を過ごしていたところ、異動先の部署で新しい技術を試作開発できる提案型のプロジェクトがあることを知りました。

「やりたかった開発を始めるにはこれしかない!」

まずはNHKプラスで開発することを思いついたのです。

というのもNHKプラスでは、放送している番組を同時配信するには、放送用の映像信号を配信用に変換するため、30秒ほどの時間を要します。

完全にリアルタイムではない状況を逆手に取り、映像と合った字幕を付けられれば、いつか放送にもつながる布石になると思ったのです。

まずは味方づくりから

ただ、この提案が採択されるまでにはさまざまな困難がありました。

提案内容に対して、部署内からは

「生字幕が遅れるのはしかたがないことなのではないか」

「生字幕の遅れが解消されるのは、そこまでうれしいことなの?」

といった疑問視する声があったのです。

しかし、私自身が生字幕付きで番組を見ながら抱いていた違和感や、なにより「生字幕の遅れで困っている人がいる」ということがずっと頭にありました。

「これができれば、喜んでくれる人がいるんだ!」という気持ちはブレることなく、「なんとしても開発したい」と、行動を起こすことに。

これまでの経験から私は、新しく何かを開発する際は、その効果がひと目でわかるように試作品を作ってきました。

実際に見たり体感してもらったりすることで、まずは理解者を増やしていくことが大切だからです。

今回の生字幕の遅れを解消するシステムについても、言葉で伝えてもその効果はなかなか理解しにくいものでした。

そこで、字幕の表示タイミングを番組に合わせた動画と、声と字幕がずれた動画を見比べることができるデモコンテンツを作り、関係者に見せることにしました。

そのときのデモコンテンツはこちらです。画像をクリックすると再生できますので、ぜひその違いを体感してください。

このデモを見てもらった結果、当初否定的だった人も「これは効果的なサービスになるかもしれない」と好反応を示してくれるようになり、もくろみ通り理解者を増やすことができました。

“ぴったり”への道のり

こうしてなんとかNHKプラスでの開発提案は採択されたものの、次に直面したのが、「このシステムを技術的にどう実現するか」という課題でした。

「さあ、どうしたらよいか…」

考えを巡らせているとき、「そもそも音声のひと言ひと言が、番組の何分何秒に発声されているかを把握することが第一歩だ!」と思いつきました。

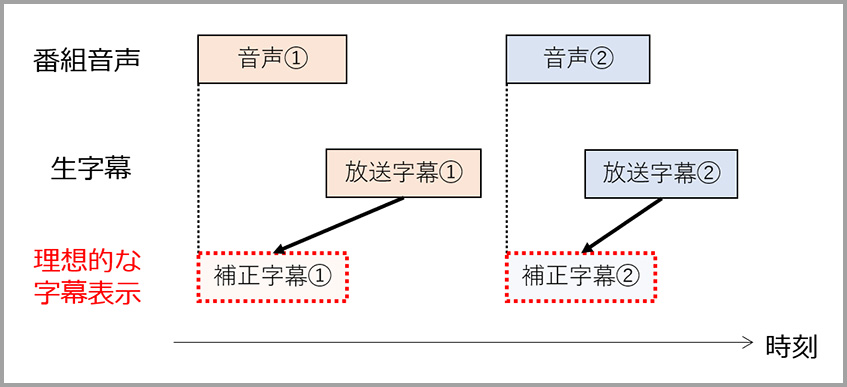

図解するとこういうことです。

そして考えたのは、「音声認識技術を活用することで、なにかヒントを得られないか」ということ。

ただ、音声認識技術について私にはあまり知見がありませんでした。

そこで頼ったのは、専門家がそろう古巣のNHK技研。

改めて説明すると、NHK技研というのは日本唯一の放送技術分野を専門とする研究機関で、音声認識を専門にするグループもあります。

そこで研究者に話を聞いてみると、「NHK技研で開発した音声認識モデルは、たしかに精度は高いが、たまにことばを間違えて認識することもある」とのこと。

私は音声認識させた結果をそのまま生字幕にする案を考えていましたが、聴覚に障害がある方にとってはことばの正確性も重要です。

さらに研究者との議論を進めていくと、NHK技研の音声認識モデルでは、発声された“時刻”を推定できることがわかりました。

この“時刻”を利用すれば、ことばに合わせて字幕を表示できそうです。しかし、そのことばは正確ではないかもしれない。

一方、人が入力している生字幕は、ことばは正確ですが、遅れて表示されます。ということは…

「そうか、2つのいいとこ取りをすればいいんだ!」

こうして、「正確なテキストの“ことば”は放送で使っている生字幕を利用し、それを表示する“時刻”は音声認識モデルから推定する」という核となるアイデアを思いついたのです。

その後は開発するシステムの仕様を固めるために、周辺の技術課題にも取り組みました。

具体的には、上記のように生字幕と音声認識モデルのいいとこ取りをしたデータを抽出する技術や、そのデータと音声認識結果を見比べるテキストマッチング技術などについて調査しました。

ほかにも、局内の有識者へのヒアリングのほか、関連技術や類似する先行技術が世の中にないかなど、ひとつひとつの課題を潰していきました。

そして検討した内容を仕様書にまとめ、ソフトウェア開発企業にもご協力いただいて、システムを組み立てていきました。

試作が「ぴったり」!ついに世の中に

改良を重ねること半年弱。ついに試作システムが完成しました。

そのシステムを実際に映像で作動させ、モニター画面で確認することに。その瞬間、大きな衝撃が走りました。

「ウソみたいに生字幕が音声とぴったり合っている…!!!」

予想外の高い精度に鳥肌が立ちました。

さまざまな方の力を借りて作り上げた、その名も「生字幕同期システム」が完成した瞬間でした。

「ここまでうまく動けば、もっと理解者を増やせるかもしれない」そんな思いを胸に、やっと構築できたシステムをサービス化する段階へ。

NHKプラスの「同時配信」よりも、まずはシステムを組み込む際のリスクが少ない「見逃し配信」でこのシステムを運用することが決まりました。

そして迎えた2020年8月3日。

その日、私は放送センター内にある機器ラック室で待機していました。

事前に多くの過去番組を使って正しく動作することは検証済みでしたが、サービスが開始されるまで不安は尽きません。

「実際の放送番組に適用したときに、意図しないおかしな動きをしないだろうか…」など、この日はずっとそわそわしていました。

いよいよ「おはよう日本」のNHKプラス「見逃し配信」がスタート。無事字幕が同期しているのを確認でき、「やっと始まったんだ…」とこれまでの苦労が報われた瞬間でした。

2018年にシステムを試作してから、実に2年後のことでした。

サービス開始後は聴覚に障害がある方がブログで紹介してくれるなど、注目されたことにもうれしさを感じました。

いよいよ同時配信へ

見逃し配信での運用が開始し、局内は一息ついた雰囲気になりました。 しかし、私には心残りがありました。

この生字幕同期システムを提案したとき、私はニュースなどの即時性のある生番組の字幕をぴったりにすることを構想していました。聴覚に障害がある方からすれば、そういった番組こそがこのシステムの必要性を一番感じてもらえるのではないかと考えたからです。NHKプラスのもう1つの「同時配信」にもこのサービスを導入することが必要だと思いました。

そこで、聴覚に障害があり、まだ生字幕同期サービスを利用したことがない方に、体験していただき、ヒアリングする機会を作りました。

お見せしたのは、「同時配信」でぜひ実現したい、ニュース番組やトーク番組などのデモコンテンツ。すると、こんな声が挙がったのです。

みなさんの声を受けて、このサービスが「番組の楽しさを伝えるツールになる」と実感するとともに、「生字幕の遅れはやはり非常に大きな課題である」と再認識しました。

そして、「同時配信でのサービス化は私の使命なんだ」という強い決意を抱くようになり、当事者の方の声を説得材料にして、同時配信での導入が決まりました。

システムを組み込むのはそう簡単ではありませんでしたが、もうあとは前に進むだけ。

「見逃し配信」と同じ生字幕同期システムを組み込むわけですが、「同時配信」でのリスクは、システムがうまく作動しなかったときに、「動画視聴を停止させてしまう」「出るべき字幕が表示されなくなる」といった多大な影響が生じること。課題を慎重に洗い出し、解決方法を整理しながら進めていきました。

そして、この生字幕同期システムを常時稼働させた場合に、運用コストを最小限に抑える方法も併せて検討。 こうして、技術的な実現性や運用コストの懸念を完全に払拭することができました。

ユーザーの喜びがやりがいにつながる

多くの課題を乗り越え、「ついにこれから実整備だ!」と思っていた矢先、札幌局への異動を命ぜられました。

ただ、これまでこのプロジェクトを担当していたこともあり、札幌局からリモートで整備に関わることに。

そして、2024年1月15日。

生放送のニュース番組を対象に、NHKプラス同時配信での生字幕同期サービスを開始することができました。

現在は、こちらの番組で生字幕同期サービスが提供されています。

「NHK NEWS おはよう日本」

「NHKニュース7」

「ニュースウオッチ9」

「サタデーウオッチ9」

※そのほか、毎日正時に放送されている全国向けニュースや、

災害時などに特設されるニュースでも提供されています。

(2024年4月 現在)

NHKプラス 「ニュース番組まとめ」はこちらから

サービス開始後は、SNSで視聴者から好意的な投稿を目にするなど、多くの反響がありました。

振り返ってみると、すべての始まりは、食堂のテレビを見ながら覚えた違和感でした。

あの日から7年。SNSでの声やヒアリング調査を通じて、「違和感を抱いているのは自分だけではないはずだ」と確信し、さまざまな人たちの力を借りながら開発を続けてきました。

サービスが実現してなによりもうれしかったのが、自分が信じて取り組んできた仕事によって、喜んでくれる人がたくさんいたこと。

今後も多くの人に喜ばれるような、世の中に新しい価値観を生み出す仕事をしていきたいと思います。